Zoals velen van jullie wellicht weten, onlangs ChatGPT was het onderwerp van studie door het team van DeepMind. Als onderdeel van Google hebben wetenschappers en academici in deze sector die zich toeleggen op kunstmatige intelligentie ontdekt dat dit via een aantal trucjes mogelijk is persoonlijke gegevens van gebruikers traceren. De privacy komt met deze tool dus in gevaar, tenminste totdat OpenAI er een patch op plakt. Maar hoe kun je jezelf beschermen?

3 manieren om uzelf te beschermen tegen ChatGPT-datalekken

Voer geen gevoelige informatie in

Eén ding dat velen onderschatten is helaas dat de chatbot houdt bij wat erin wordt gestoken. Als we meestal minimaal gevoelige gegevens laten analyseren (telefoonnummers, in plaats van persoonlijke gegevens zoals inkomsten, uitgaven, banknamen enzovoort), slaat ChatGPT deze op en bewaart ze in het geheugen. Op een later tijdstip, zoals benadrukt door het DeepMind-experiment, zou deze informatie opnieuw naar boven kunnen komen en nogal wat problemen kunnen veroorzaken.

Zowel bij het laden van gegevens, als bij het kopiëren en plakken van iets is het noodzakelijk voer geen gevoelige gegevens in. Als het niet mogelijk is om te voorkomen dat u ze invoegt, is het een goed idee om een anonimisering werk. Deze methode maakt gebruik van kunstmatige intelligentie om persoonlijke gegevens automatisch te identificeren en gevoelige informatie te vervangen door middel van verschillende ‘maskeertechnieken’.

Schakel ChatGPT “Chatgeschiedenis en training” uit.

Nog iets poco bekend of op zijn minst onderschat is hetgene dat ons zorgen baart data-training via de chats die we maken met ChatGPT. In principe kun je een indicatie geven aan de OpenAI chatbot gebruik wat u schrijft niet als onderdeel van het trainingsproces, hoe nuttig ook voor het verbeteren van het potentieel en de output van het systeem.

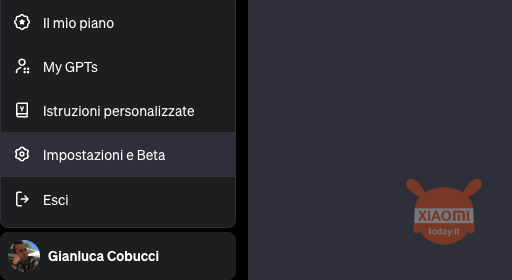

Om de betreffende geschiedenis te deactiveren, gaat u eenvoudigweg naar ons profiel linksonder en klikt u op "Instellingen en bèta“, zoals aangegeven op de onderstaande foto:

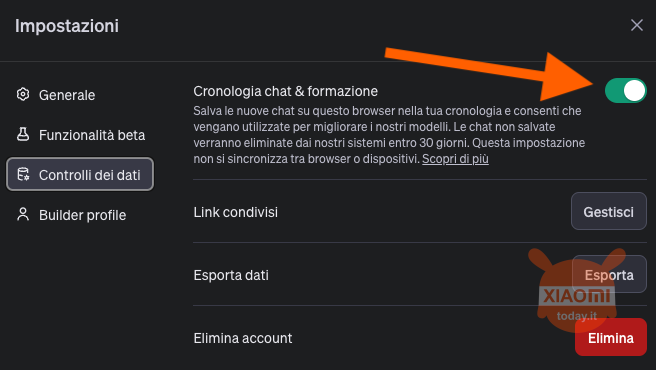

Zodra dit is gebeurd, gaat u naar “Gegevenscontrolesi” in het menu aan de linkerkant en je ziet “Chat- en trainingsgeschiedenis“. Als u de functie uitschakelt nieuwe chats worden niet opgeslagen in je geschiedenis en worden niet gebruikt voor training door ChatGPT:

Er is een “maar”. Helaas, als we aan de ene kant meer privacy krijgen aan de andere kant onze chatgeschiedenis wordt ook gedeactiveerd. Als OpenAI ons in staat stelt de privacy te beschermen, neemt het in wezen een zeer nuttige functie weg.

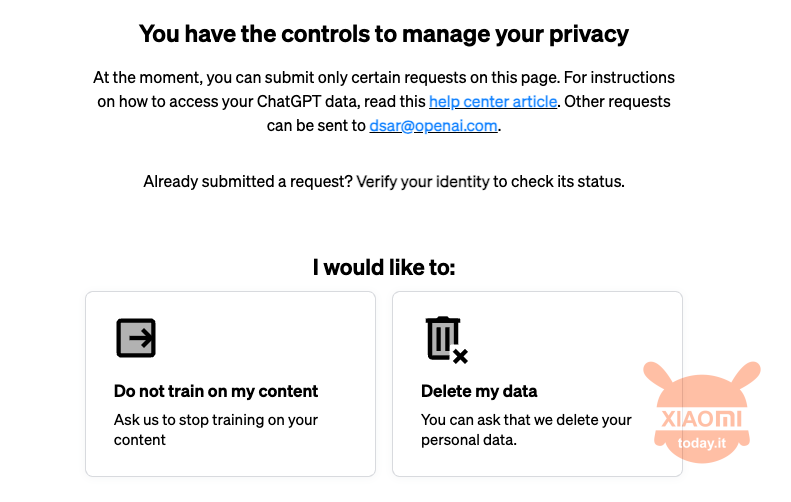

Vraag een “privacyverzoek” aan bij OpenAI

Er is een manier om privacyverzoeken aan het OpenAI-team te richten deze speciale pagina. Met deze tool kunt u twee verzoeken indienen bij ChatGPT:

- vraag om OpenAI-modellen niet op uw gegevens te trainen

- vragen om uw gegevens uit ChatGPT te verwijderen